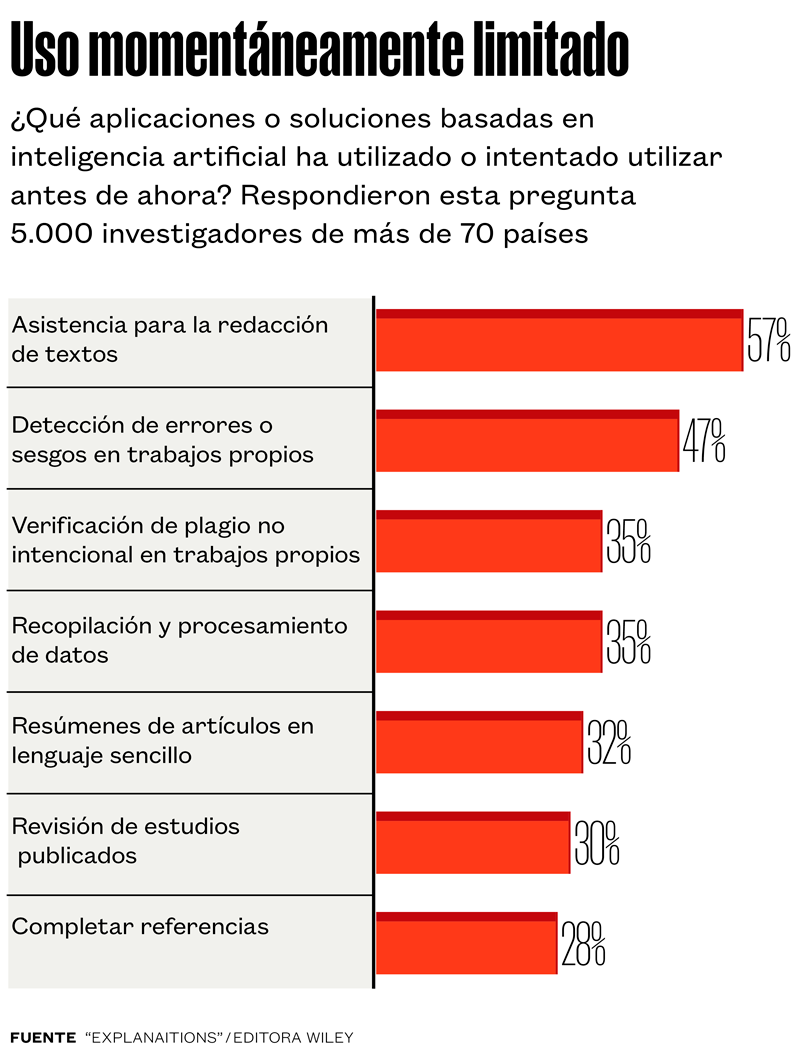

El uso de las herramientas de la inteligencia artificial (IA) generativa en las investigaciones científicas por ahora es limitado y apunta fundamentalmente a las tareas relacionadas con la redacción académica, pero existe una percepción mayoritaria en la comunidad científica de que en los próximos dos años su uso se hará más extendido, según una encuesta realizada por la editorial Wiley en la que participaron casi 5.000 investigadores de más de 70 países, entre ellos 143 brasileños (véase la infografía abajo). “Existe un amplio consenso en que la inteligencia artificial va a reconfigurar el campo de la investigación científica”, le dijo a la revista Nature el vicepresidente de Wiley, Josh Jarret, responsable del área de IA de la empresa.

Los entrevistados dieron su opinión en cuanto a si la IA ya es capaz de superar a los seres humanos en la realización de actividades académicas prácticas. Estimaron –más de la mitad de ellos– que, efectivamente, la tecnología produce mejores resultados que las personas en tareas tales como identificar posibles colaboradores, generar resúmenes o contenidos educativos a partir de artículos científicos, constatar la existencia de plagio en textos, aportar referencias bibliográficas o realizar un seguimiento de la publicación de artículos científicos en áreas específicas.

Sin embargo, para la mayoría de los participantes, los humanos son irreemplazables en labores tales como predecir tendencias, seleccionar revistas para publicar artículos, designar revisores, gestionar tareas administrativas y explorar posibilidades de financiación. Pese al interés creciente, los encuestados –un 81 %– se mostraron preocupados en cuanto a la aparición de posibles sesgos en los resultados, los riesgos en lo que concierne a la privacidad y la falta de transparencia en la forma en que se entrenan estas herramientas. Casi dos tercios de ellos declararon que la falta de orientación y capacitación les impide utilizar la IA tanto como les gustaría.

“Aquí en Brasil, muchos investigadores aún tienen dudas sobre las pautas éticas que deben guiar el uso de estas herramientas y sería importante que organismos tales como la Coordinación de Perfeccionamiento del Personal de Nivel Superior [Capes] y el Consejo Nacional de Desarrollo Científico y Tecnológico [CNPq] establecieran directrices orientativas”, dice el politólogo Rafael Sampaio, de la Universidad Federal de Paraná (UFPR), uno de los autores de una guía que contiene directrices para un uso ético y responsable de la IA generativa en la investigación científica, publicada en diciembre en colaboración con el administrador de empresas Ricardo Limongi, de la Universidad Federal de Goiás (UFG), y Marcelo Sabbatini, experto en educación digital de la Universidad Federal de Pernambuco (UFPE).

En su trabajo como investigador, Sampaio utiliza herramientas de IA como NotebookLM, una plataforma de Google que le permite al usuario formular preguntas sobre temas de su investigación y obtener resúmenes basados en los contenidos recopilados por el programa. La herramienta, por ahora disponible en forma gratuita, es capaz de “conversar” simultáneamente hasta con 50 archivos, entre ellos artículos científicos en formatos PDF, audio y video.

“Utilizo este servicio sobre todo cuando estoy haciendo grandes búsquedas, para realizar una primera selección y elegir lo que realmente voy a leer. También me sirve cuando necesito encontrar rápidamente algún artículo que ya leí pero no recuerdo el título o el autor”, comenta. Una de las funciones del programa que cautivó a los usuarios son los resúmenes de los archivos analizados en formato de pódcast, donde dos personas conversan, todo ello generado por IA.

La guía reúne y describe una serie de herramientas que, al igual que NotebookLM, pueden ser de utilidad para los investigadores, sin dejar de aclarar que la función de la IA es de asistencia y en todos los procesos en los que se las utilicen la supervisión humana es esencial. Limongi, coautor del manual, utiliza a menudo dos programas informáticos ‒LitMaps y Scite‒ para realizar revisiones de la literatura en temas específicos. Permiten cargar un artículo científico en PDF y generar mapas interactivos que muestran las conexiones de ese trabajo con otros papers, además de mostrar los enlaces e identificar referencias precisas para mejorar la argumentación.

Limongi subraya que es necesario formar a los investigadores para que conozcan las limitaciones de las herramientas y advierte que el uso excesivo de este tipo de software sin un enfoque crítico puede generar en los futuros científicos una pérdida de habilidades esenciales, como realizar lecturas complejas y organizar ideas en un texto articulado. “La IA es una ayuda, pero es el investigador quien debe planificar y dirigir su estudio. No puede convertirse en un mero pulsador de teclas”, recalca. Las revistas científicas no permiten que las herramientas de IA sean consideradas autoras de artículos académicos, siempre es un humano el responsable de los resultados científicos y de los textos que elabora con dicha ayuda.

Claude.ai, un chatbot (programa de IA que simula conversaciones humanas) que compite con ChatGPT, puede ser útil para generar estructuras de textos. La plataforma ha sido utilizada por Sabbatini, de la UFPE, para desarrollar la estructura inicial y revisar textos académicos y de divulgación científica. “Le pido sugerencias acerca de cómo abordar un tema y, a continuación, cuáles serían las vías para desarrollarlo. La herramienta genera una estructura y yo voy dialogando con ella, mientras busco, chequeo y complemento esa información con mi conocimiento y óptica personal.”

Julia Jabur

Julia Jabur

La herramienta, creada por la startup estadounidense Anthropic, se erigió como la mejor evaluada en un estudio publicado en mayo en la revista Royal Society Open Science, que analizó la capacidad de 10 programas de IA generativa, incluyendo ChatGPT y DeepSeek, para generar resúmenes confiables de artículos científicos. Sin embargo, el resultado general de la evaluación fue desfavorable para los chatbots en su conjunto, ya que dedujeron conclusiones imprecisas o sobredimensionadas en hasta un 73 % de los 5.000 artículos científicos resumidos.

El ingeniero de materiales Edgar Dutra Zanotto, investigador de la Universidad Federal de São Carlos (UFSCar), utiliza chatbots tales como ChatGPT, DeepSeek, Claude, Perplexity y Gemini para diversas tareas. Se vale de estas herramientas, por ejemplo, para revisar textos en inglés, realizar cálculos (como calcular la composición molar de un vidrio a partir del peso molecular de los elementos) y seleccionar posibles revisores de artículos científicos para la revista Journal of Non-Crystalline Solids, de la que él es el editor. “Sondeo quiénes son los investigadores más influyentes en el tema que necesito revisar”, comenta.

Dutra Zanotto ya tenía experiencia con la inteligencia artificial en el área del aprendizaje automático: con su grupo del Centro de Investigación, Educación e Innovación en Vidrios (CeRTEV), uno de los Centros de Investigación, Innovación y Difusión (Cepid) financiados por la FAPESP, entrenaron un algoritmo con los datos de 55.000 composiciones de vidrios, una base de datos con un volumen inédito en el área, capaz de sugerir estructuras que nunca han sido creadas. Antes de que existiera la IA, el desarrollo de las nuevas composiciones se hacía a prueba y error. “De esta manera, es posible crear un nuevo vidrio en un mes, algo que antes llevaba años, y cualquier vidrio nuevo generaba una tesis”, dice.

Hay usos de la inteligencia artificial para soluciones matemáticas, que se pueden realizar en programas como MathGPT. También se la utiliza como ayudar en la programación. “Aplicaciones como Claude y Gemini han sido muy utilizadas tanto para generar como para evaluar códigos”, dice Limongi.

Como estas herramientas son entrenadas por bases de datos de información que ya existe en internet, pueden reproducir ciertos sesgos. A veces, también generan “alucinaciones”, inventando términos, nombres y referencias. Para evitar estos inconvenientes, Dutra Zanotto testea las respuestas que necesita en más de un chatbot, con el propósito de cotejar los datos y obtener información más fidedigna.

Una de las misiones de los programas de uso popular como ChatGPT es lo que se conoce como brainstorming, o exploración inicial de ideas, merced a su capacidad de rastrear y combinar información en gigantescas bases de datos. En una “conversación” con la herramienta, el investigador puede pedir sugerencias sobre los caminos que podría seguir con respecto a un determinado tema. Pero deben evaluarse las posibilidades, ya que algunas ideas podrían no ser exclusivas, dado que los modelos son entrenados con información ya existente, aunque también son capaces de sugerir nuevas variantes.

El ingeniero de producción Roberto Antonio Martins, de la UFSCar, ha probado el uso de programas tales como ChatGPT, Copilot y DeepSeek utilizando la función de investigación profunda (deep research), recientemente incorporada a estas herramientas. Esta función realiza búsquedas avanzadas en la web, incluso en fuentes académicas, y genera informes con un resumen del tema y una lista de fuentes de la información recabada, explica.

En esta modalidad de búsqueda, la herramienta suele hacerle preguntas al usuario antes de iniciar su exploración, para crear así un prompt (un comando introducido por el usuario para generar una respuesta) bien estructurado. Martins siempre comienza esta etapa preguntándole a la herramienta sobre el tema que necesita explorar. “No se trata de una búsqueda por palabra clave, como solíamos hacer, sino por una pregunta que, a diferencia de las palabras clave, proporciona un contexto más específico, lo que permite obtener resultados más precisos”, dice Martins, quien ha impartido conferencias sobre el uso de la IA generativa en la investigación académica.

Hay que formar a los investigadores en lo que se refiere a las limitaciones de la IA

El chatbot Perplexity ha conquistado a los usuarios del ambiente académico por proporcionar información basada en los resultados más recientes de internet, que incluye notas al pie con el vínculo a las fuentes de donde se extrajo la información. “Utilizo estas herramientas cuando empiezo a recopilar información y a formular hipótesis sobre un nuevo tema de investigación”, dice la brasileña Cyntia Calixto, profesora de comercio internacional en la británica Leeds University Business School, quien ha utilizado estos programas en sus investigaciones sobre el activismo de los directores generales de empresas que toman partido sobre temas polémicos en las redes sociales. “La IA funciona como un asistente con el que voy discutiendo un tema a medida que lo exploro”.

Cuando la tarea implica identificar artículos científicos de interés para el investigador, una opción que Calixto suele utilizar es la plataforma SciSpace, que realiza una búsqueda de artículos y presenta un resumen de cada uno de ellos. El biomédico Aydamari Faria-Jr., de la Universidad Federal Fluminense (UFF), destaca otras dos herramientas: Answer This y Elicit, que permiten explorar múltiples bases de datos científicos, como PubMed y Scopus. “Disponen de filtros que optimizan el proceso de búsqueda y permiten acotarla, por ejemplo, a ensayos clínicos aleatorios, revisiones sistemáticas con o sin metaanálisis o a contenidos transversales”, señala. Suele complementar el trabajo con la consulta manual a las bases de datos, para asegurarse de realizar un amplio barrido sobre el tema que está investigando en ese momento.

La ayuda que proporcionan los programas de inteligencia artificial en la redacción de artículos se extiende a las cuestiones relacionadas con la integridad científica, como evaluar si las citas incluidas en un paper son sólidas y confiables. La plataforma Scite exhibe el contexto original de una cita de un artículo científico y muestra, mediante una clasificación elaborada por un modelo de aprendizaje profundo, si dicha cita se basa realmente en el texto de referencia o contrasta con su contenido. La abogada Cristina Godoy, de la Facultad de Derecho de la USP en Ribeirão Preto (FDRP-USP), suele utilizar esta herramienta.

Gracias a ella encontró un artículo publicado en la revista Nature que complementó un trabajo de su autoría sobre inteligencia artificial. “La plataforma identifica artículos científicos que tratan sobre el tema y proporciona un enlace a cada uno de esos papers. También permite seleccionar la revista en la que se desea realizar la búsqueda”, dice Godoy, quien suele utilizar otras herramientas de IA para analizar datos y toma sus precauciones al utilizar programas de inteligencia artificial generativa: nunca realiza búsquedas empleando fragmentos de trabajos que aún no han sido publicados, porque sabe que ese contenido puede ser utilizado para entrenar a la herramienta, y nunca se sabe si las ideas pueden ir a parar a los resultados de las investigaciones de otros usuarios.

Este artículo salió publicado con el título “Asistente virtual” en la edición impresa n° 352 de junio de 2025.

Republicar